Services on Demand

Journal

Article

Indicators

-

Cited by SciELO

Cited by SciELO

Related links

-

Similars in

SciELO

Similars in

SciELO

Share

Revista Iberoamericana de Tecnología en Educación y Educación en Tecnología

Print version ISSN 1851-0086On-line version ISSN 1850-9959

Rev. iberoam. tecnol. educ. educ. tecnol. no.26 La Plata Sept. 2020

ARTÍCULOS ORIGINALES

Revisión sistemática del enfoque teórico y las variables oculomotoras registradas en estudios de seguimiento ocular en el área de ciencias de la computación e ingeniería en sistemas

Systematic review of the theoretical approach and the oculomotor variables recorded in eye-tracking studies in the area of computer science and systems engineering

Luis Villalobos1, Álvaro De la Ossa1

1 Universidad de Costa Rica, Montes de Oca, Costa Rica.

lvillalobosfernadez@gmail.com, alvaro.delaossa@gmail.com

Recibido: 19/06/2019 | Corregido: 28/04/2020 | Aceptado: 19/05/2020

Cita sugerida: L. Villalobos and Á. De la Ossa, “Revisión sistemática del enfoque teórico y las variables oculomotoras registradas en estudios de seguimiento ocular en el área de ciencias de la computación e ingeniería en sistemas,” Revista Iberoamericana de Tecnología en Educación y Educación en Tecnología, no. 26, pp. 47-55, 2020. doi: 10.24215/18509959.26.e5

Resumen

Este estudio tiene como objetivo determinar cuáles son las variables oculomotoras más utilizadas en investigaciones de seguimiento ocular orientadas a las áreas de ciencias de la computación e ingeniería en sistemas. Para ello se revisaron 26 trabajos académicos publicados entre el 2012 y el 2018. Se llevó a cabo un análisis de conglomerados jerárquicos, del que se desprenden tres grandes grupos, uno exploratorio en los que se utiliza el seguimiento ocular para conocer a mayor profundidad un fenómeno, otro comparativo en que se desea averiguar cuál de dos o más procesos es más eficiente y sobre todo intuitivo, empleándose el seguimiento ocular como herramienta para determinar esa eficiencia. Un tercer grupo sería el de estudios en que se emplea el seguimiento ocular como interfaz usuario – computadora.

Las variables más empleadas son tiempo de fijación (50 %), duración media de la fijación (46.3 %), linealidad (42.3 %), tasa de fijación (34.6 %), recuento de fijaciones (26.9 %), y duración media de las fijaciones relevantes (23.1 %). Estas variables se encuentran presentes en los tres grandes grupos en que se divide la muestra. Además, se hace una revisión de los contextos en los que las variables menos empleadas son de utilidad.

Palabras clave: Computación; Ingeniería; Seguimiento ocular; Variables oculomotoras.

Abstract

The objective of this study is to determine which oculomotor variables are most used in eye tracking research oriented to the areas of computer science and systems engineering. To this end, 26 academic papers published between 2012 and 2018 were reviewed. An analysis of hierarchical clusters was carried out, from which three large groups emerged, one exploratory in which ocular monitoring is used to gain a deeper knowledge of a phenomenon, another comparative in which we want to find out which of two or more processes is more efficient and above all intuitive, using eye tracking as a tool to determine that efficiency. A third group would be that of studies in which eye tracking is used as a user-computer interface.

The variables most used are fixation time (50%), average duration of fixation (46.3%), linearity (42.3%), fixation rate (34.6%), fixation count (26.9%), and average duration of fixation. Relevant fixations (23.1%). These variables are present in the three large groups in which the sample is divided. In addition, a review is made of the contexts in which the least used variables are useful.

Keywords: Computing; Engineering; Eye-tracking; Oculomotor variables.

1. Introducción

En este artículo se llevó a cabo una revisión sistemática de estudios de seguimiento ocular, pertenecientes a las áreas de ciencias de la computación e ingeniería en sistemas publicados entre el 2012 y el 2018. El aporte que se pretende con este trabajo es ayudar a determinar las variables oculomotoras que son de mayor utilidad, según el tipo de problema computacional o de ingeniería en sistemas que se desea estudiar. Este trabajo se llevó a cabo como parte del trabajo final de graduación en la Maestría Académica en Ciencias Cognoscitivas de la Universidad de Costa Rica.

2. Antecedentes

Anteriormente se han publicado revisiones sobre trabajos de seguimiento ocular relativos al desarrollo de software [1], [2], lo cual aportó una estandarización de las métricas empleadas en este tipo de estudios, ya que diversos estudios utilizan términos diferentes para referirse a una misma medición. Esta terminología estandarizada es la que se emplea en el presente trabajo. Sin embargo, dichos trabajos no toman en cuenta estudios relativos al desarrollo de hardware, además no se encontraron en esas revisiones ninguna referencia a trabajos en español, elemento que se subsana en el presente estudio. En total se analizaron 26 trabajos, de los cuales 8 están en español.

3. Metodología

Para la búsqueda solo se incluyeron artículos con texto completo y que hubieran sido publicados entre el 2012 y el 2018 en revistas académicas indexadas y que tengan proceso de revisión por pares, conferencias académicas en las que se expongan resultados de proyectos de investigación, o trabajos finales de graduación de universidades de prestigio.

La búsqueda se llevó a cabo en las bases de datos ACM Digital Library, EBSCOhost, IEEE Explorer, Redalyc y Science Direct. Para cada trabajo se extrajeron las variables oculomotoras, el estímulo sometido a estudio y el objetivo del estudio.

Con los datos obtenidos, se elaboró por medio del programa estadístico SPSS 20 [3] un análisis de conglomerados jerárquicos, empleando método de Ward [4]. Esto para llevar a cabo una clasificación del material. Además, se elaboró un análisis de frecuencias de todas las variables y se contrastó con los grupos formados por los conglomerados.

De esta forma, se detectaron variables que son más generalistas y sirven para la mayoría de problemas a tratar, y otras que son de utilidad para contextos muy específicos.

3.1. Criterios de inclusión y exclusión

Se incluyeron aquellos trabajos que cumplan las siguientes características:

1. Artículos académicos, conferencias o tesis que traten de estudios de seguimiento ocular relativos a problema computacional o de ingeniería en sistemas.

2. Se detalla claramente la muestra, la tarea ejecutada, el programa utilizado y los resultados obtenidos.

Se excluyeron aquellos artículos que tengan alguna de las siguientes características:

1. Artículos que vuelven a informar los resultados, o hacen un nuevo análisis de un experimento previamente publicado.

2. Artículos que no involucran un estudio empírico.

3. Aspectos importantes de la metodología o los resultados están ausentes.

3.2. Colección y selección de artículos

Para la búsqueda se especificó que solo se incluyeran artículos con texto completo y que hubieran sido publicados entre el 2008 y el 2018 en revistas académicas indexadas y que tengan proceso de revisión por pares. Las palabras de búsqueda en las bases académicas en inglés fueron las siguientes: eye tracking, computational exercise, computational training, programming. Mientras que en español fueron seguimiento ocular, ejercicio computacional, entrenamiento computacional y programación.

4. Variables oculomotoras

Tras la revisión de todos los documentos que se detallan en la tabla 1 se lograron identificar las siguientes variables oculomotoras. Las cuales se muestra ordenadas en orden alfabético, por su nombre en español.

Tabla 1. Variables oculomotoras, estímulos y objetivos

▪ Área de casco convexo (ACC): representa el área de los más pequeños conjuntos convexos de fijaciones que contiene todas las fijaciones de un participante para visualizar la distribución espacial de fijaciones y mostrar las partes preferidas de un estímulo visual. Tiene como problemática que es muy sensible a los valores extremos.

▪ Coincidencia de escaneo (SM): calcula la similitud de dos rutas de escaneo.

▪ Densidad espacial de fijación (SD): representa la cobertura de área y dispersión de las fijaciones. Se lleva a cabo dividendo el área total en un determinado número de casillas y se cuantifica en cuantas hay presentes fijaciones.

▪ Duración media de la fijación (AFD): es la suma de duración de todas las fijaciones divididas por el número de fijaciones.

▪ Duración media de las fijaciones relevantes (ADRF): es la duración total de las fijaciones para las áreas de interés relevantes.

▪ Linealidad (L): determina la estrategia de búsqueda de un participante para un estímulo, por ejemplo, de izquierda a derecha o de arriba abajo.

▪ Recuento de fijaciones (FC): es el número total de fijaciones en cada área de interés. Varios estudios se refieren a esta métrica como el total número de fijaciones. Un mayor número de fijaciones muestra que la búsqueda de información relevante no es eficiente.

▪ Relación en objetivo del tiempo de fijación de todos los objetivos (ROAFT): es la suma de las duraciones de todas las fijaciones en un área de interés, dividida por la duración de todas las fijaciones del área de la mirada.

▪ Tasa de fijación (FR): muestra la relación entre las fijaciones totales y las fijaciones en áreas de interés relevantes. Una baja tasa de fijación es indicativa de que hay dificultad para detectar los estímulos relevantes.

▪ Tasa de regresión (RR): indica el porcentaje de sacadas regresivas de cualquier longitud. Mayor cantidad de regresiones es indicativa de que los usuarios tienen dificultades para comprender el contenido observado.

▪ Tasa normalizada de fijaciones relevantes (NRRF): permite comparar dos o más estímulos. Si un estímulo requiere fijaciones más relevantes que otro, entonces requiere más esfuerzo visual.

▪ Tiempo de fijación (FT): es la suma de las duraciones de todas las fijaciones en un área de interés.

▪ Tiempo de clic (TC): el tiempo transcurrido entre el momento en el que aparece la figura en la pantalla y el clic.

▪ Tasa de error en el clic (TEC): es la relación entre el número de tareas fallidas (clic fuera del objeto en pantalla) y la cantidad total de tareas realizadas.

▪ Tasa de fallo de calibración (TFC): es la relación entre el número de fallos de calibración debido a una calibración de baja calidad y el número de calibraciones realizadas.

5. Resultados

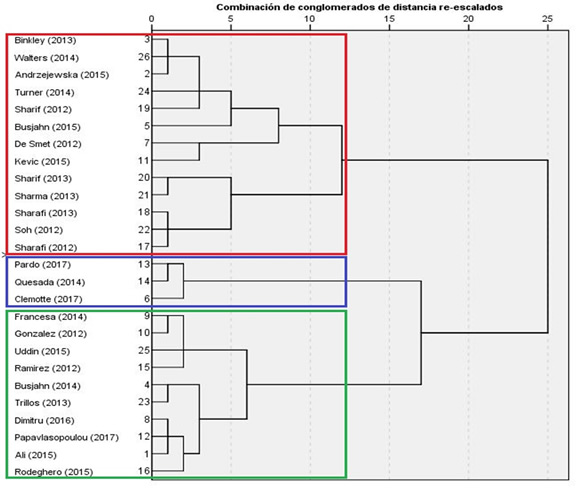

Por medio del programa estadístico SPSS 20 se llevó a cabo un análisis de conglomerados jerárquicos con método de Ward (figura 1).

Figura 1. Dendograma

Esta es una técnica estadística multivariante cuya finalidad es dividir un conjunto de objetos en grupos de forma que los perfiles de los objetos en un mismo grupo sean muy similares entre sí (cohesión interna del grupo) y los de los objetos de conglomerados diferentes sean distintos (aislamiento externo del grupo).

Se seleccionaron todas las variables oculomotoras antes mencionadas para elaborar el análisis.

Se llevó a cabo un análisis de conglomerados jerárquicos, del que se desprenden tres grandes grupos, uno de estudios exploratorios en los que se utiliza el seguimiento ocular para conocer a mayor profundidad un fenómeno, otro comparativo en que se desea averiguar cuál de dos o más procesos es más eficiente y sobre todo intuitivo, empleándose el seguimiento ocular como herramienta para determinar esa eficiencia. Un tercer grupo seria el de estudios que emplean el seguimiento ocular como interfaz usuario – computadora.

El dendograma permite visualizar los casos que conforman cada uno de los grupos sugeridos, al nivel 10 surgen 3 grupos diferentes. En la tabla 2 se describen a profundidad estos grupos, así como las características que tienen en común.

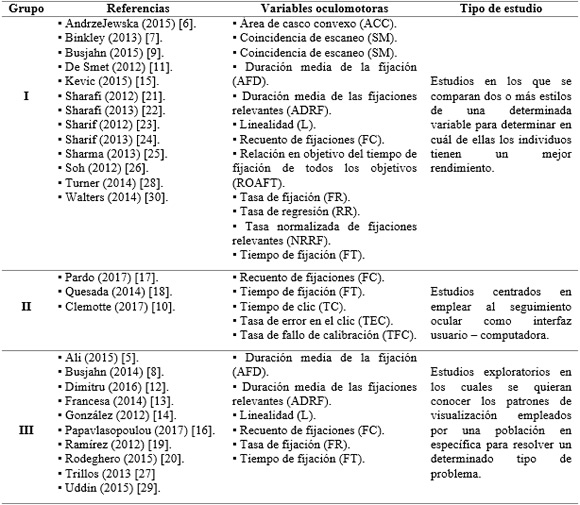

Tabla 2. Grupos

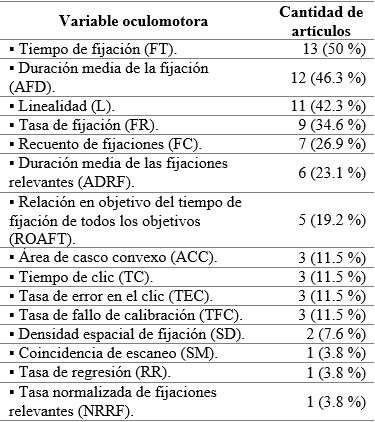

Las variables más empleadas (ver tabla 3) son tiempo de fijación (50 %), duración media de la fijación (46.3 %), linealidad (42.3 %), tasa de fijación (34.6 %), recuento de fijaciones (26.9 %), y duración media de las fijaciones relevantes (23.1 %). Estas variables se encuentran presentes en los tres grandes grupos en que se divide la muestra se encuentran tanto en los estudios comparativos como exploratorios y constituyen las variables principales de la mayoría de los estudios analizados. Estas variables oculomotoras son las que aportan datos más generales sobre el desplazamiento de la mirada y por ello se recurre a ellas en la mayoría de estudios.

Tabla 3. Variables más utilizadas

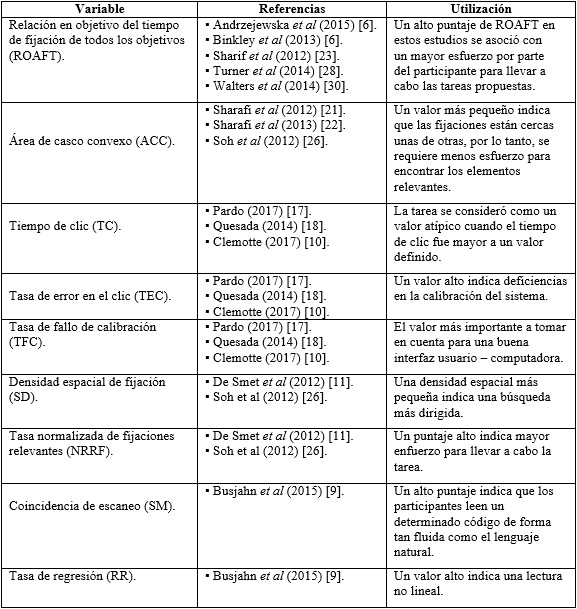

Las variables relación en objetivo del tiempo de fijación de todos los objetivos (ROAFT), área de casco convexo (ACC), tiempo de clic (TC), tasa de error en el clic (TEC), tasa de fallo de calibración (TFC), coincidencia de escaneo (SM), densidad espacial de fijación (SD), tasa de regresión (RR) y tasa normalizada de fijaciones relevantes (NRRF), presentan una frecuencia baja dentro del conjunto de toda la muestra y se presentan sobre todo en estudios correspondientes a los grupos I y II (ver tabla 2), los cuales son de mayor complejidad, por lo que resulta de interés revisar que función desempeñaron en esos contextos (ver tabla 4).

Tabla 4. Variables de uso especifico

Conclusiones

En base al análisis de los datos se generaron tres grupos, I) estudios en los que se comparan dos o más estilos de una determinada variable para determinar en cuál de ellas los individuos tienen un mejor rendimiento, II) estudios centrados en emplear al seguimiento ocular como interfaz usuario – computadora y III) estudios exploratorios en los cuales se quieran conocer los patrones de visualización empleados por una población en específica para resolver un determinado tipo de problema. Cada uno con sus correspondientes variables, las cuales se muestran en la tabla 2.

Esta categorización servirá para ayudar a los investigadores que quieran hacer nuevas investigaciones en el tema a definir que variables son de interés para su investigación.

Agradecimientos

Dr. Odir Rodríguez Villagra - profesor Escuela de Psicología, Universidad de Costa Rica.

Dr. Adrián Vergara Heidke - profesor Escuela de Filología, Lingüística y Literatura, Universidad de Costa Rica.

[1] Z. Sharafi, T. Shaffer, B. Sharif and Y. G. Guéhéneuc, “Eye-tracking metrics in software engineering” in Asia-Pacific Software Engineering Conference, New Delhi, Dec. 2015. Doi: 10.1109/APSEC.2015.53.

[2] U. Obaidellah and M. Al Haek, “A survey on the usage of eye-tracking in computer programing,” ACM computing surveys, vol. 51, no. 1, pp 1-58, 2018.

[3] Manual del usuario del sistema básico de IBM SPSS 20, IBM, Madrid, 2011. [ Links ]

[4] S. Fernández, Análisis conglomerados. Madrid España: Universidad Autónoma de Madrid, 2011. [ Links ]

[5] N. Ali, Z. Sharafi, Y. Gueheneuc and G. Antoniol, “An empirical study on the importance of source code entities for requirements traceability,” Empirical software engineering, vol. 20, pp. 442-478, 2015.

[6] M. Andrzejewska, A. Stolinska, W. Blasiak, P. Pkeczkowski, R. Rosiek, B. Rozek, M. Sajka and D. Wcislo, “Eye-tracking verification of the strategy used to analyse algorithms expressed in a flowchart and pseudocode,” Interactive learning environments, vol.24, no. 8, pp. 1-15, 2015.

[7] D. Binkley, M. Davis, D. Lawrie, J. Maletic, C. Morrell and B. Sharif, “The impact of identifier style on effort and comprehension,” Empirical software engineering, vol. 18, no. 2, pp. 219-276, 2013.

[8] T. Busjahn, R. Bednarik, C. Sohule, “What influences dwell tiem during source code reading? Analysis of element type and frecuency as factors,” in ETRA '14: Proceedings of the Symposium on Eye Tracking Research and Applications, 2014, pp. 335-338. https://doi.org/10.1145/2578153.2578211

[9] T. Busjahn, R. Bednarik, A. Begel, M. Crosby, J. Paterson, C. Schulte, B. Sharif, S. Tamm, “Eye movements in code reading: relaxing the linear order,” in Proceedings of 22th international conference on program comprehension, 2015.

[10] A. Clemotte, M. Velasco, R. Raya, R. Ceres, R. Córdoba and E. Rocon, “Metodología de evaluación de eye-trackers como dispositivos de acceso alternativo para personas con parálisis cerebral,” Revista Iberoamericana de Automática e Informática Industrial, vol. 14, no. 4, pp. 384-393, 2017.

[11] B. De Smet, L. Lempeteur, Z. Sharafi, Y. Gueheneuk, G. Antoniol and N. Habra, “TAUPE: visualizing and analyzing eye-tracking data,” Science of computer programming, vol. 79, pp. 260-278, 2012.

[12] R. Dumitru, “Caracterización de patrones de actividad mediante el seguimiento ocular,” Trabajo fin de grado, Ingeniería Informática, Universidad Autónoma de Madrid, Madrid, España, 2016.

[13] C. Francesa, “Arquitectura de información para un negocio de comercio electrónico en Costa Rica”. Tesis de Maestría Profesional con énfasis en Sistemas de Información, Instituto Tecnológico de Costa Rica, Costa Rica, 2014.

[14] L. González and J. Velásquez, “Una aplicación de herramientas de eye-tracking para analizar las preferencias de contenido de los usuarios de sitios web,” Revista de ingeniería de sistemas, vol. 26, pp. 95-118, 2012.

[15] K. Kevic, B. Walters, T. Shaffer, B. Sharif, D. Shepherd and T. Fritz, “Tracing software developers eye and interactions for change tasks,” in ESEC/FSE 2015: Proceedings of the 2015 10th Joint Meeting on Foundations of Software Engineering, 2015, pp. 202-213, doi: 10.1145/2786805.2786864.

[16] S. Papavlasopoulou, K. Sharma, M. Giannakos and L. Jaccheri, “Using eye-tracking to unveil differences between kids and teens in coding activities,” in Proceeding of the 2017 conference on interaction design and children, 2017, pp. 171-181.

[17] C. Pardo, “Desarrollo de un sistema embebido de eye tracking para personas con discapacidades motrices superiores,” Trabajo de grado, ingeniero en electrónica, Escuela Superior Politécnica de Chimborazo, Ecuador, 2017.

[18] M. Quesada, “Interacción persona–ordenador mediante la captura del movimiento ocular utilizando la herramienta de eye–tracking Tobii,” trabajo de grado, Ingeniería en Informática, Universidad de Castilla-La Mancha, España, 2014.

[19] A. Ramírez, “Eye-tracking: una técnica de seguimiento de la mirada utilizada en la validación de unidades de aprendizaje,” in XIII Encuentro internacional virtual educa, Panamá, 2012.

[20] P. Rodeghero, P. Cheng, W. McBurney and C. McMillan, “An eye-tracking study of Java programmers and application to source code summarization,” IEEE Transactions of Software Engineering, vol. 41, pp. 1038- 1054, 2015.

[21] Z. Sharafi, Z. Soh, Y. Guéhéneuc and G. Antoniol, "Women and men - Different but equal: On the impact of identifier style on source code reading," 2012 20th IEEE International Conference on Program Comprehension (ICPC), Passau, 2012, pp. 27-36, doi: 10.1109/ICPC.2012.6240505. [ Links ]

[22] Z. Sharafi, A. Marchetto, A. Susi, G. Antoniol and Y. Guéhéneuc, "An empirical study on the efficiency of graphical vs. textual representations in requirements comprehension," 2013 21st International Conference on Program Comprehension (ICPC), San Francisco, CA, 2013, pp. 33-42, doi: 10.1109/ICPC.2013.6613831. [ Links ]

[23] B. Sharif, M. Falcone and J. Maletic, “An eye-tracking study on the role of scan time in finding source code defects,” Proceedings of the symposium on eye tracking research & applications, New York, 2012, pp. 381-384.

[24] B. Sharif and J. Aponte, “An empirical study assessing the effect of seeIT 3D on comprehension,” Proceeding of 1st IEEE working conference on software visualization, Eindhoven, Netherlands, 2013, pp. 1-10.

[25] K. Sharma, P. Jermann, M. Nussli and P. Dillenbourg, “Understanding collaborative program comprehension: interlacing gaze and dialogues,” Computer-Supported Collaborative Learning Conference, CSCL, vol. 1, pp. 430-437, 2013.

[26] Z. Soh, Z. Sharafi, B. Van den Plas, G. Cepada, Y. Gueheneuc, and G. Antoniol, “Professional status and expertise for UML class diagram comprehension: An empirical study,” IEEE International Conference on Program Comprehension, pp. 163-172, 2012, doi: 10.1109/ICPC.2012.6240484.

[27] J. Trillos and O. Vargas, “Elaboración e implementación de un software capaz de rastrear el movimiento ocular usando MATLAB, para la aplicación y desarrollo del cuestionario de reconocimiento de emociones faciales,” Trabajo de grado, Ingeniería Electrónica, Universidad Pontifica Bolivariana, 2013.

[28] R. Turner, M. Fallone, B. Sharif and A. Lazar, “An eyetracking study assessing the comprehension of C++ and Python source code,” in Proceedings of the Symposium on Eye Tracking Research and Applications (ETRA '14), New York, USA, 2014, pp. 231–234, doi: https://doi.org/10.1145/2578153.

[29] M. Uddin, V. Gaur, C. Gutwin, and K. Roy, “On the comprehension of code clone visualization: a controlled study using eye-tracking,” in Proceedings of the 2015 IEEE 15th international working conference on source code análisis and manipulation, 2015, pp. 161-171, doi: 10.1109/SCAM.2015.7335412.

[30] B. Walters, T. Shaffer, B. Sharif and H. Kagdi, “Capturing software traceability links from developers eyegazes,” in Proceedings of the 22nd international conference on program comprenhension, 2014, pp. 201–204, doi: https://doi.org/10.1145/2597008.2597795.

Información de Contacto de los Autores:

Luis Villalobos

Tibás

Costa Rica

lvillalobosfernadez@gmail.com

Álvaro de la Ossa

Montes de Oca

Costa Rica

alvaro.delaossa@gmail.com

Luis Villalobos

Licenciado en psicología por la Universidad de Costa Rica. Estudiante egresado de la maestría en Ciencias Cognoscitivas de la Universidad de Costa Rica.

Álvaro de la Ossa

Doctor en ciencias de la computación por la Universidad de Kaiserslautern. Profesor de la Escuela de la Computación y de la maestría en Ciencias Cognoscitivas de la Universidad de Costa Rica.