Objetivo: Explorar qué puede aportar la Aeronáutica (A) para mejorar la calidad de la Cirugía Cardíaca (CC). Medicina traslacional.

INTRODUCCIÓN

En 1984, Perrow expone su teoría de “Accidentes normales” y habla de complejidad de interacción, donde las catástrofes son inevitables en sistemas complejos acoplados firmemente. Predice que van a ocurrir fallas de muchas maneras impredecibles. La falla de un componente puede tener múltiples efectos “río abajo” (downstream). En estos sistemas, hay pocas posibilidades de substituir o reasignar personal debido a la altísima especialización, contacto personal cerrado y poca comprensión de algunos procesos. Hay un punto en la organización, el cual, una vez traspasado, resulta en el colapso del nivel siguiente. Al llegar a él, puede ocurrir un cambio que en sí mismo es insignificante, pero que en el sistema puede llevar a una transformación masiva, rápida y catastrófica. 1 Ejemplos de esto serían accidentes de aviación o pacientes complicados que sufren ciclos de errores o de CEC, olvidando dar heparina para iniciarla. El análisis sistémico de los accidentes muestra que estos resultan de una alineación de condiciones y sucesos, cada uno de los cuales es necesario, pero ninguno solo es suficiente para provocarlo.

DOS EJEMPLOS QUE RELACIONAN A Y CC: EN AMBOS, LOS ACTORES NO COMPRENDEN LA COMPLEJIDAD EXISTENTE POR FALTA DE ENFOQUE SISTÉMICO

Vuelo Airbus 330 Río-París AF 447/2009: Durante este vuelo, una tormenta congeló el sensor de velocidad (tubo Pitot) por lo cual se desconectó el piloto automático. Los dos jóvenes pilotos a cargo, al no comprender el problema, actuaron desincronizadamente, no pidieron ayuda y el avión cayó. El accidente fue explicado finalmente por la caja negra. El error residió por incomunicación entre el hombre y la máquina: los pilotos a cargo no estaban entrenados para esa situación crítica no comprendida. (AF 447 Final report 2012 www.bea.aero/enquetes/flight.af.447/rapport.final.en.php.)

En la década de 1980, en una institución local, hubo una serie de pacientes operados con CEC quienes, ya despiertos y neurológicamente activos, fueron extubados. Luego de la toma de sangre para gases y posterior purga de la línea, aparecieron convulsiones y coma. Se invitó a un investigador externo para aclarar el problema, que se había enfocado inicialmente en fallas en la de aireación cardíaca o en la CEC. El investigador, sin embargo, encontró que la introducción de un nuevo método de purga posoperatorio de la línea arterial introducía burbujas a una presión tan alta que superaba la del arco aórtico y lo inyectaba en las carótidas.

COMPLEJIDAD EN EL QUIRÓFANO

Este es un ambiente caracterizado por un alto grado de complejidad con respecto a las interfaces humano-tecnológica y humano-humana. Los procedimientos requieren esfuerzos coordinados de múltiples grupos, trabajando bajo estrés. La composición humana aquí es continuamente cambiante, al revés que en la aviación. Por ello puede haber problemas de comunicación con desenlaces catastróficos. Durante la CEC, en caso de necesitarse bajo flujo o paro circulatorio total, un mínimo error puede ser fatal.

Se ha asegurado que los cirujanos cardíacos toman una decisión de vida o muerte cada 10 s durante una operación. La mayoría estaría de acuerdo en que el 75% de los resultados se atribuyen a decisiones correctas (p. ej., cómo purgar aire del corazón) y el 25% a la técnica (p. ej., punto en coronaria). Marvil, en 2017, sugiere mantener permanentemente una conciencia de situación (situation awareness), que es el grado de exactitud con el cual la percepción copia a la realidad. 2 Un homólogo a los controladores de vuelo en Aeronáutica es la ecografía transesofágica que permite controlar paso a paso resultados funcionales de una cirugía.

SIMILITUDES Y DIFERENCIAS ENTRE CIRUGÍA CARDÍACA Y AVIACIÓN

La primera se practica con una “puerta abierta” a mucha gente; la segunda, dentro de un cockpit cerrado. El personal en un avión es menor en número que el de un quirófano: si en la cabina de un jet intervienen 3 pilotos, en el quirófano, lo hacen más de 10 personas de diferentes especialidades, lo que aumenta la complejidad a medida que aumenta el número. Los equipos de trabajo en cirugía son heterogéneos, incluso en sus modos de comunicación; sin embargo, la complementariedad es mayor por las subespecialidades. La intrincación de las relaciones interhumanas crecen exponencial y no linealmente con el número de presentes, lo que disminuye la calidad del liderazgo (Pendharkar, 2007). 3 La falta de éste puede impedir la recuperación de errores en circunstancias críticas. Cardiocirugía es “Aeronáutica y algo más”: el ser humano es más complejo que un avión. Ambos campos requieren celeridad para manejar situaciones de crisis o emergencia, a veces, con poca información. Los cirujanos cardíacos se encuentran necesariamente con éstas, frecuentemente roturas o disecciones de aorta. En la urgencia quirúrgica, hay que salir a “volar con mal tiempo”, lo que la diferencia en parte de la A, aunque en esta durante el vuelo pudieran aparecer emergencias. Un ejemplo de excelencia en manejo crítico en aeronáutica fue la conducta de los pilotos durante el vuelo US Airways 1549. El comandante se entrenó toda su vida para una eventualidad que quizás nunca le iba a ocurrir, lo predecible de lo impredecible: acuatizar. (Eisen 2009). 4

En la cabina, la función de los pilotos se superpone en cierto grado (son substitutivas), en quirófano, por motivos organizativos y económicos, no siempre sucede. Si se cae el avión, cae el piloto con él. En aviación comercial, se arriesgan muchas vidas por vuelo; en cirugía, solo una. Los accidentes aéreos son públicos, altamente visibles y generan demandas para su investigación y reparación. Como resultado, se generan más recursos económicos para investigar, mientras que los eventos adversos iatrogénicos se mantienen en reserva (Bogner, 1994). 5

MEDICINA TRASLACIONAL DE A A CC: LA SEGURIDAD AÉREA LLEVADA AL PACIENTE

1. Reporte de incidentes (CHIRP) y auditoría observacional (LOSA)

La tasa imposible de alcanzar en seguridad de la aviación comercial (en EE.UU. los accidentes fatales son mínimos: 0,017/100 000 vuelos /año) seduce a la traslación. Máxime cuando el Instituto de Medicina de los EE. UU. estima que cada año entre 44 000 y 98 000 personas mueren por causa de errores médicos (Helmreich, 2000). 6 La ciencia de los factores humanos, piedra angular de la seguridad en aviación, no ha encontrado aún su lugar en la Medicina, pero podría cambiar profundamente la comprensión y ejecución de las decisiones médicas (Schappell, 2007; Eltorai, 2018). 7,8 Buscando qué factor hay impredecible o complejo que relacione a la Aviación y la Medicina, ese es el factor humano. En la era actual, las nuevas maravillas tecnológicas han creado una expectativa de perfección total. Los pacientes, que tienen una necesidad comprensible de considerar infalible al médico, han colusionado (pactado) con éstos para negar la existencia del error y rechazar la incertidumbre, lo único seguro muchas veces. Wiegmann, analizando el sistema en CC, propone que el error se relaciona con disrupciones al flujo quirúrgico provocadas por fallas en la comunicación, distracciones externas y fallas en el hardware. 9

El reporte no solo de accidentes, sino de los cuasiaccidentes (near misses) es clave en el programa CHIRP (Confidential Human Factors Incident Reporting). Este permite hacer reportes no punitivos (Eidt, 2012). 10 Helmreich, psicólogo dedicado a factores humanos en aviación y cirugía, ha observado múltiples cirugías y registrado instancias de comunicación y trabajo de equipo subóptimos, paralelos a aquellos observados en el cockpit. 6

Otro elemento que puede trasladarse a la cirugía es LOSA, una auditoria observacional proyecto de Helmreich. Significa Line Operations Safety Audit, (www.psy.utexas.edu/psy/helmreich/nasaut.htm), donde observadores expertos se sientan en el cockpit de vuelos normales para registrar amenazas a la seguridad, errores y su manejo. Estos resultados confirmaron un promedio de dos amenazas y dos errores por vuelo. Más de la mitad de los errores fueron por violaciones a reglas establecidas, algo inesperado.

2. Protocolo de cabina estéril (sterile cockpit)

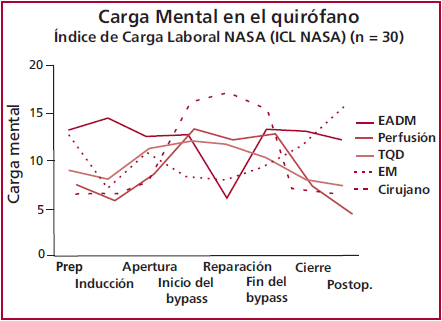

En la aviación se instituyó un protocolo de “cockpit estéril” obligatorio durante los períodos de alta exigencia mental, o sea despegue y aterrizaje. Son protocolos estandarizados de comunicación, fraseología y repeticiones (call back) para disminuir la ambigüedad. Esto fue trasladado a la Mayo Clinic donde en 2010, se definieron ocho eventos críticos durante la CEC y se implementó un protocolo símil NASA (NASA Task Load Index). Así, se disminuyeron significativamente las alteraciones en la comunicación (Wadhera, 2010). 11 Se hizo hincapié en que las acciones “no verbales” como clampear o desclampear la aorta, se redujeran al comunicarlas. Los autores concluyeron que, a diferencia de la A, en CC no hay un tiempo exacto que pueda ser definido convenientemente como el principal período de alto riesgo y estrés mental desde el punto de vista del equipo humano completo. La Figura 1, tomada de Wadhera, muestra la diferencia de carga mental en quirófano: a diferencia de la aviación, el mayor estrés, para cada componente del equipo, es en momentos diferentes.

Fig. 1 Los resultados del Índice de Carga Laboral de la Administración Nacional de Aeronáutica y el Espacio (ICL NASA) (National Aeronautics and Space Administration Task Loas Index, NASA TLX) muestran mediciones de carga cognitiva ampliamente divergentes durante el curso de un caso típico. EADM: Enfermero anestesista diplomado y matriculado. TQD: Técnico quirúrgico diplomado. EM: Enfermero matriculado. Prep: Preparación quirúrgica. Postop: Postoperatorio.

El cirujano debe hacer hincapié en enfocarse en los eventos críticos: Heparinización/entrada en CEC, clampeo/cardioplegia/desclampeo/salida de CEC, más que en períodos críticos.

3. Modelo de la NASA “amenaza y error”

El cirujano infantil Hickey sugiere considerar que cada operación sea considerada como un vuelo. Analiza 524 vuelos/paciente y encuentra 763 “amenazas preoperatorias” (morfología atípica, múltiples lesiones, comorbilidades) en 72% de estos. Registró 430 errores de proficiencia o juzgamiento, el 67% consecutivos, y en 21% del total se produjeron ciclos subsecuentes de error adicional. Estos ciclos que contenían múltiples errores se asociaron con complicaciones quirúrgicas e, incluso, muerte en el 1,3%. Concluye que un error no solucionado lleva a ciclos de error y graves complicaciones (Hickey, 2015). 12

4. Análisis de la misión: Crew resource management (CRM)

En los principios de los ochenta, a causa de varios desastres de aviación, se desarrolló en EE. UU. el CRM o Crew Resource Management, para mejorar la performance y promover la seguridad. Estas estrategias para mejorarla pueden trasladarse a la Cirugía. McGreevy, en 2007, sugiere dos pasos. En la primera parte, o Briefing (instrucciones), los pilotos explican de antemano no solo lo que se va a hacer o esperan que ocurrirá, sino las medidas a tomar en cada caso. Un ejemplo quirúrgico sería si, luego de la esternotomía se descompensara un paciente, cómo entrar inmediatamente en extracorpórea. El segundo paso o debriefing (reflexiones ) es una honda introspección sobre lo que salió bien o no, para evitar la repetición de error. 13

5. Simuladores

En A, cada incidente mayor es seguido por la simulación de sus causas para evitar otro evento posterior, ha pasado a ser parte del entrenamiento y se ha rediseñado el hardware. En Cirugía, las complicaciones se consideran una rutina y aparte de comentarse en un ateneo, no son reportadas. Los simuladores constituyen una parte estructurada del entrenamiento en A, en Cirugía están en avance gracias a la primera. Se practica sin riesgo y se aprende a desarrollar estrategias para recuperarse del error. Los pilotos no vuelan un avión para el cual no fueran entrenados en simulador, ante el cual rinden examen periódicamente. En CCV en muchas instancias un cirujano debe operar un caso para el cual no fue entrenado. Lamentablemente, la complejidad de los sistemas biológicos es casi imposible de “simular” con el mismo grado de realismo. El futuro en educación quirúrgica son los simuladores híbridos entre material plástico y órganos biológicos. Gaba, piloto e introductor de la simulación en Medicina, piensa que, si bien conceptos y prácticas de la aviación no se pueden transferir directamente, es posible y necesaria la traslación o adaptación (Gaba, 2011). 14

RESUMEN Y CONCLUSIONES

Las posibilidades de error en CC son más impredecibles.

La A se ha sistematizado mejor para resolver la seguridad, y se acepta la inevitabilidad del error.

Los médicos tienden a no reconocer éste, ni la fatiga, y conjuntamente con los pacientes hacen un pacto (colusión) para no reconocer el primero.

Trasladar las sistemáticas mencionadas de A a la Cirugía ayuda a acercarse a su estándar de seguridad aunque no resuelve el problema totalmente.

Investigar en factores humanos que afectan al error es esencial en Cirugía.